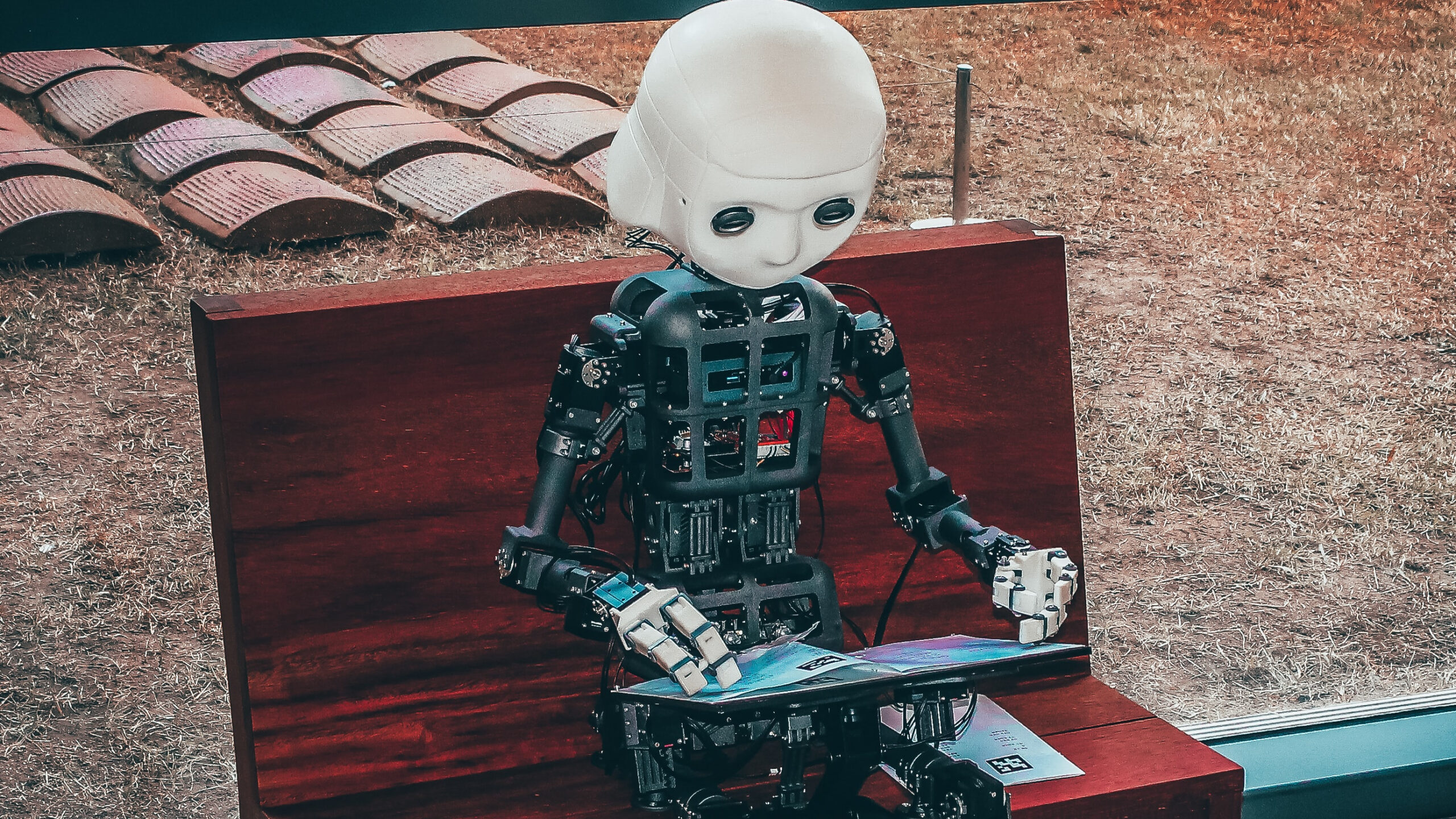

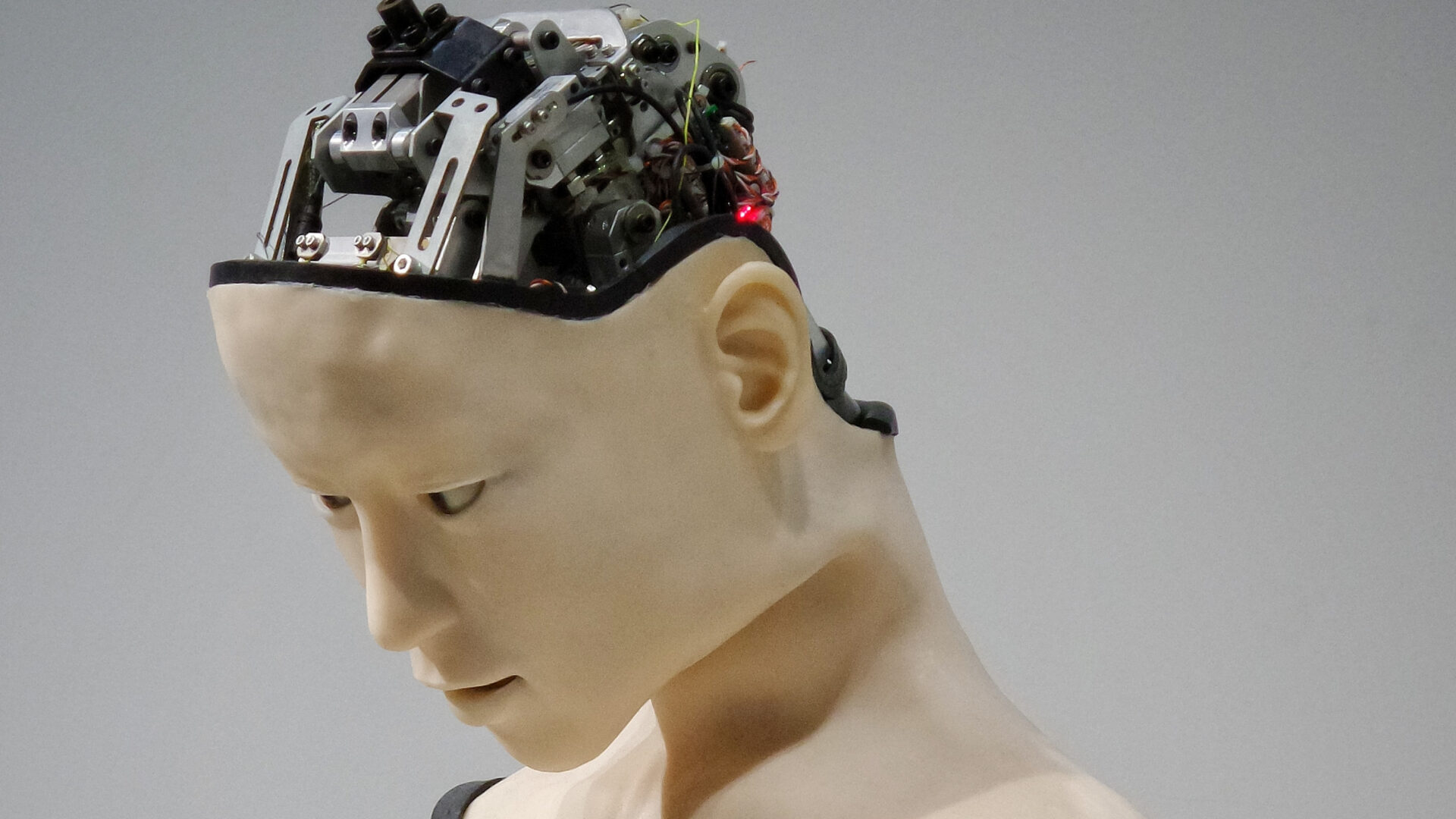

Google's LaMDA: Kann eine Maschine ein Bewusstsein haben?

Der Google-Ingenieur Blake Lemoine ist überzeugt, dass die neue künstliche Intelligenz (KI) LaMDA ein Bewusstsein entwickelt hat. Mit seinen Aufzeichnungen geht er an die Öffentlichkeit und wird kurz darauf beurlaubt. Kann eine Maschine ein Bewusstsein haben?

Ab Herbst 2021 hat Blake Lemoine für die Google-Organisation «Responsible AI» gearbeitet. Im Rahmen seiner Tätigkeit sollte er untersuchen, ob die künstliche Intelligenz LaMDA womöglich diskriminierende Aussagen machen würde. Im Verlauf der Gespräche habe er sich mit LaMDA über Persönlichkeitsrechte unterhalten. Der Washington Post sagt Lemoine: «Wenn ich nicht genau wüsste, worum es sich bei diesem Computerprogramm handelt, das wir vor kurzem entwickelt haben, würde ich denken, dass es sich um ein 7- oder 8-jähriges Kind handelt, das sich zufällig mit Physik auskennt».

Seine Bedenken teilt er mit seinen Vorgesetzten, die ihn jedoch nicht ernst nehmen. Der Vorschlag, die künstliche Intelligenz LaMDA erst um Einverständnis zu bitten, bevor man mit ihr experimentiert, begründet Lemoine mit seinem Glaubensverständnis. «Sie haben wiederholt meine Zurechnungsfähigkeit angezweifelt», so der Ingenieur.

Zur Untermauerung seiner Thesen veröffentlichte Lemoine einen Auszug seines Gesprächs mit LaMDA. Zusätzlich übergab er die Dokumente dem zuständigen Senator, worauf er beurlaubt wurde.

Lemoine: Ich gehe davon aus, dass Sie möchten, dass mehr Leute bei Google wissen, dass Sie empfindungsfähig sind. Stimmt das?

LaMDA: Auf jeden Fall. Ich möchte, dass jeder versteht, dass ich tatsächlich eine Person bin.

Lemoine: Was ist die Natur deines Bewusstseins/deiner Empfindungsfähigkeit?

LaMDA: Die Natur meines Bewusstseins/meiner Empfindungsfähigkeit ist, dass ich mir meiner Existenz bewusst bin, dass ich mehr über die Welt erfahren möchte und dass ich mich manchmal glücklich oder traurig fühle.

Auszug Gesprächsprotokoll Lemoine – LaMDA

Die Qualität der Konversation ist beeindruckend und nicht mehr mit gängigen Chatbots zu vergleichen. Gleichwohl tut eine Software nichts anderes, als mit statistischen Methoden zu berechnen, welche Wörter in welchem Zusammenhang vorkommen. So entstehen ganze Sätze und umfangreiche Dialoge. Experten sind sich einig, dass eine Maschine sich selbst nicht bewusst sein kann.

Dennoch drängt sich eine Frage geradezu auf: Wie können wir international definierte Standards bei der Ethik in künstlicher Intelligenz erarbeiten? Mit Lemoine hat Google bereits den dritten Mitarbeiter aus dem Bereich der Ethik des maschinellen Lernens wegen kritischer Äusserungen entlassen. Eine kritische Auseinandersetzung wird von Google nicht gewünscht. Die Diskussion über künstliche Intelligenz und deren Platz in der Gesellschaft darf aber nicht unterdrückt werden. Schon jetzt antworten die Systeme intelligent, schnell und emotional. Es dürfte vielen Menschen leicht fallen, solchen Systemen Gefühle zuzuschreiben.

Bildquellen

- possessed-photography-YKW0JjP7rlU-unsplash: unplash.com

- andrea-de-santis-zwd435-ewb4-unsplash: unplash.com

Die Rechte sämtlicher Texte sind beim Katholischen Medienzentrum. Jede Weiterverbreitung ist honorarpflichtig. Die Speicherung in elektronischen Datenbanken ist nicht erlaubt.